Durch den rasanten Fortschritt von KI entstehen neue Bedrohungen: Wie Unternehmen sich auf Voice- und Video-Phishing-Angriffe vorbereiten können.

„Matthias, das eilt jetzt etwas. Können Sie schnell 250.000 Euro auf das Konto unseres neuen Partners überweisen? Die Vertragsunterzeichnung läuft gerade und wir brauchen das als Anzahlung.“ Die Stimme am Telefon klingt vertraut – es ist der Vorstandsvorsitzende. Matthias, Finanzchef eines ostwestfälischen Automobilzulieferers, wird trotzdem stutzig. Eine persönliche Rückfrage reicht dann aus – der vermeintliche CEO legt auf. Dieser Deepfake-Angriff wurde gerade noch abgewehrt. Das Beispiel eines Kunden des Herforder Cybersecurity-Unternehmens audatis ist kein Einzelfall. Die Bedrohung durch KI-basierte Angriffe und Identitätsfälschungen mittels Voice Phishing und Video-Deepfakes ist keine Science-Fiction mehr und nimmt völlig neue Dimensionen an. Voice Phishing stieg in der zweiten Jahreshälfte 2024 um 442 Prozent im Vergleich zum ersten Halbjahr, meldet der Cybersecurity-Anbieter Crowdstrike. Betroffen sind Unternehmen jeder Größe – vom Kleinbetrieb bis zum Konzern. Klassisches Phishing erkennen wir alle: schlecht geschriebene Massen-E-Mails mit verdächtigen Links. Dagegen sind Deepfake-Angriffe hochpräzise Spear-Phishing-Operationen mit perfekten Doppelgängern.

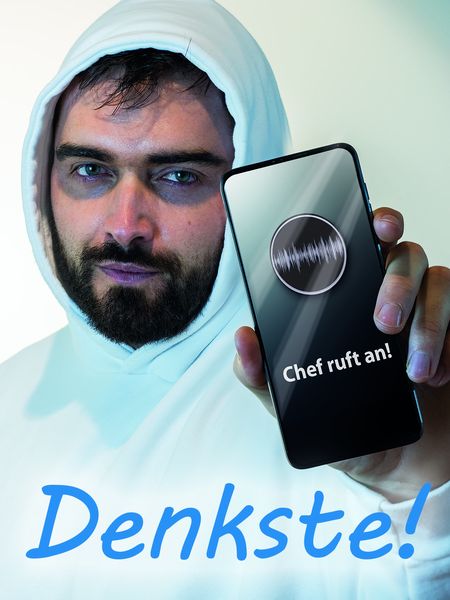

Als „White Hacker“ testet Cybersecurity-Experte Marcel Albrink die Sicherheits- konzepte von Unternehmen gezielt auf Schwachstellen.

(Foto: audatis)

Die neue Dimension der Täuschung

• Voice Cloning: Drei Sekunden Audiomaterial genügen zum Generieren täuschend echter Anrufe und Sprachnachrichten.

• Deepfake-Videos: In KI-generierten Videos werden Gesichter in Echtzeit getauscht: gefälschte Videokonferenzen stiegen 2024 um 300 Prozent an.

KI-Angriffe setzen auf menschliche Psychologie statt technischer Schwachstellen. Deepfakes sind so erfolgreich, weil sie uns an einer verwundbaren Stelle treffen: in unserem Vertrauen zu bekannten Personen. Perfekte Imitation kombiniert mit emotionalem Druck wirkt verheerend. Und der Schutz davor beginnt nicht bei der Technik, sondern im Kopf. „Die perfekte KI-Fälschung nutzt nichts, wenn die Mitarbeiter wissen, worauf sie achten müssen. Vertrauen ist gut – Verifikation ist besser. Im Zweifel einfach auflegen und zurückrufen“, rät Marcel Albrink, Cybersecurity-Experte bei audatis.

Auch in der Abwehr gilt: Psychologie schlägt Technologie. Die Human Firewall ist heute wichtiger denn je, denn traditionelle Maßnahmen wie Spam-Filter und E-Mail-Scanner helfen nicht gegen Angriffe per Telefon oder Videokonferenz.

Deepfake-Technologie ist gut, schnell – und erschreckend zugänglich. Selbst mit kostenlosen Voice-Cloning-Tools kann jeder (Klein-)Kriminelle das tun, was früher nur Geheimdienste konnten. 2026 wird das Jahr des automatisierten, skalierbaren und nicht nachweisbaren Verbrechens werden.

Bei Investitionen in proaktive Awareness statt reaktiver Schadensbegrenzung gibt es aber enormen Aufholbedarf: Über 80 Prozent der Unternehmen haben noch keine Protokolle für KI-Angriffe.

Cybersecurity ist ein kontinuierlicher Lernprozess. Statt besserer Firewalls braucht es klügere und besser trainierte Menschen. Teams müssen auf Szenarien geschult werden, die es vor zwei Jahren noch nicht gab:

• Verifikationsprozesse für telefonische Anweisungen

• Vier-Augen-Prinzip bei außergewöhnlichen Zahlungen

• Offline vereinbarte Code-Wörter für Notfälle

• Regelmäßige realitätsnahe Schulungen und Trainings zu aktuellen Bedrohungen

Mit Social-Engineering-Simulationen gewappnet im KI-Zeitalter

Ein praktisches Tool sind Phishing-Simulationen, wie sie audatis durchführt. Kontrollierte Voice-Cloning-Tests und realistische Video-Simulationen bereiten die Kunden auf den Ernstfall vor. In den anonymisierten Testläufen erkennen sogar erfahrene Führungskräfte die Voice-Phishing-Angriffe oft nicht.

Eine typische Simulation beginnt mit einer E-Mail des „IT-Supports“ oder einer Systemnachricht wegen eines „Sicherheitsproblems“, dann folgt ein Anruf vom KI-Klon des IT-Leiters. Über 90 Prozent der Teilnehmenden fallen zuerst auf KI-basiertes Phishing herein. Gezieltes Training senkt die Quote auf unter 30 Prozent.

Individualisierte Szenarien sind dreimal effektiver als Standardtests, da jedes Unternehmen andere Schwachstellen hat. Mittelständler sind leichter durch CEO-Fraud verwundbar, Konzerne kämpfen mit komplexen Freigabeprozessen. Erfolgreiche Phishing-Kampagnen bilden diese Realitäten ab. Regelmäßige, angepasste Social-Engineering-Simulationen senken das Risiko für Unternehmen um bis zu 70 Prozent.

Im Wettlauf gegen Deepfakes evaluiert audatis proaktiv neue Bedrohungsszenarien und nutzt dafür selbst KI-Technologie. Carsten Knoop, Geschäftsführer audatis: „Wir entwickeln unsere Simulationen permanent weiter, weil sich die Bedrohung täglich verändert. Was gestern noch Science-Fiction war, probieren Kriminelle heute aus. Unsere Aufgabe ist es, einen Schritt voraus zu sein. Denn die zentrale Frage ist nicht: Werden wir angegriffen?, sondern: Sind unsere Mitarbeiter bereit, wenn es passiert?“

Weitere Informationen www.audatis.de